蚂蚁开源首个万亿参数推理大模型 Ring-1T-preview

蚂蚁集团近日宣布开源其自研的万亿参数思考模型 ring-1t 的预览版本——ring-1t-preview。

该模型继承了Ling 2.0高效的MoE架构,基于20T高质量语料完成预训练,并结合此前已公开的“棒冰”(icepop)方法,在蚂蚁自研的高效强化学习系统ASystem(其核心框架AReaL已开源)上,进行了专门针对推理能力优化的RLVR训练。

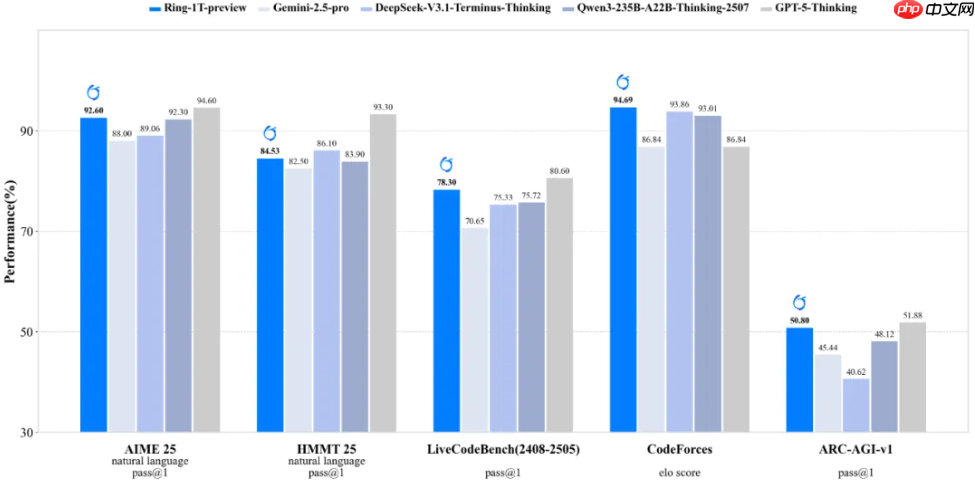

据官方介绍,在大规模强化学习训练的初期阶段,Ring-1T的语言基座模型便已展现出卓越的自然语言推理能力。在AIME 2025(美国数学邀请赛)测试中,该模型仅通过纯文本推理即取得了92.6的高分,接近GPT-5 with thinking (no tools) 所达到的94.6水平。

不仅如此,模型在多项高难度任务中也表现抢眼,包括哈佛-麻省理工数学竞赛HMMT 2025、竞赛级代码生成评测LiveCodeBench v6、CodeForces编程挑战,以及抽象推理基准ARC-AGI-1等场景,均体现出强大的综合竞争力。

为进一步探索Ring-1T早期版本的推理极限,研发团队将其接入多智能体协同框架AWorld,并在IMO 2025(国际数学奥林匹克竞赛)的六道题目上开展了纯自然语言推理测试。

作为对比,此前团队曾用相同方法测试过Ring-flash-2.0模型:在允许三次尝试的情况下,该模型直到第三次才勉强解出第3题。而Ring-1T在此轮测试中仅需一次推理便成功解答第3题,并在第1、2、4、5题中一次性输出了部分正确解法。

目前,团队正持续开展更多复杂推理任务的验证工作,如ICPC、CCPC等顶级编程竞赛场景,以全面挖掘这一万亿级思考模型的潜力。

需要指出的是,Ring-1T仍在持续训练过程中。尽管本次发布的预览版已具备出色的推理能力,但仍存在诸如语种混杂、推理过程重复、身份认知偏差等问题。蚂蚁方面表示将持续优化迭代,推动模型能力进一步提升。

<< 上一篇

下一篇 >>

网友留言(0 条)